Tribune

David Gruson

Directeur du Programme Santé du Groupe Jouve & Pilote de la commission IA du CRAPS

Voici quelques semaines, le CRAPS consacrait un rapport de premières analyses et propositions consacré aux enjeux du déploiement et de la régulation de l’intelligence artificielle (IA) dans le domaine de la protection sociale. Le CRAPS y préconisait la reconnaissance du principe d’une « garantie humaine » de l’IA.

L’introduction de ce principe pour l’intelligence artificielle en santé dans la révision de la loi de bioéthique représente une étape très importante, sans doute extrapolable à d’autres domaines de la régulation éthique du numérique. Cette proposition, portée initialement dans le cadre de l’initiative Ethik-IA, avait pu être reprise dans le cadre du rapport de Cédric Villani sur l’intelligence artificielle et, plus spécifiquement, dans le cadre de l’avis 129 et du rapport dédié émis par le Comité consultatif national d’éthique dans le cadre du processus de préparation de la révision bioéthique.

Sur le fond, ce principe renvoie à des valeurs très fortes portées en France et en Europe, placées au cœur de notre protection sociale et qui visent à garder l’Humain au premier plan. L’objectif général est d’éviter des mécanismes de « délégation » de nos décisions aux outils numériques et algorithmiques. Plus largement, la logique de la loi du plus grand nombre intrinsèque au pilotage algorithmique peut être source d’atteintes à la primauté de la Personne.

S’ouvrir résolument à l’innovation et essayer d’en réguler les enjeux éthiques au fil de son application : c’est le sens du principe d’une « Garantie Humaine » du numérique et de l’intelligence artificielle. En retenant ce principe, la France fait le choix d’une approche enfin plus ouverte de l’innovation, dans un cadre législatif et réglementaire qui est déjà, il est vrai, le plus protecteur au monde.

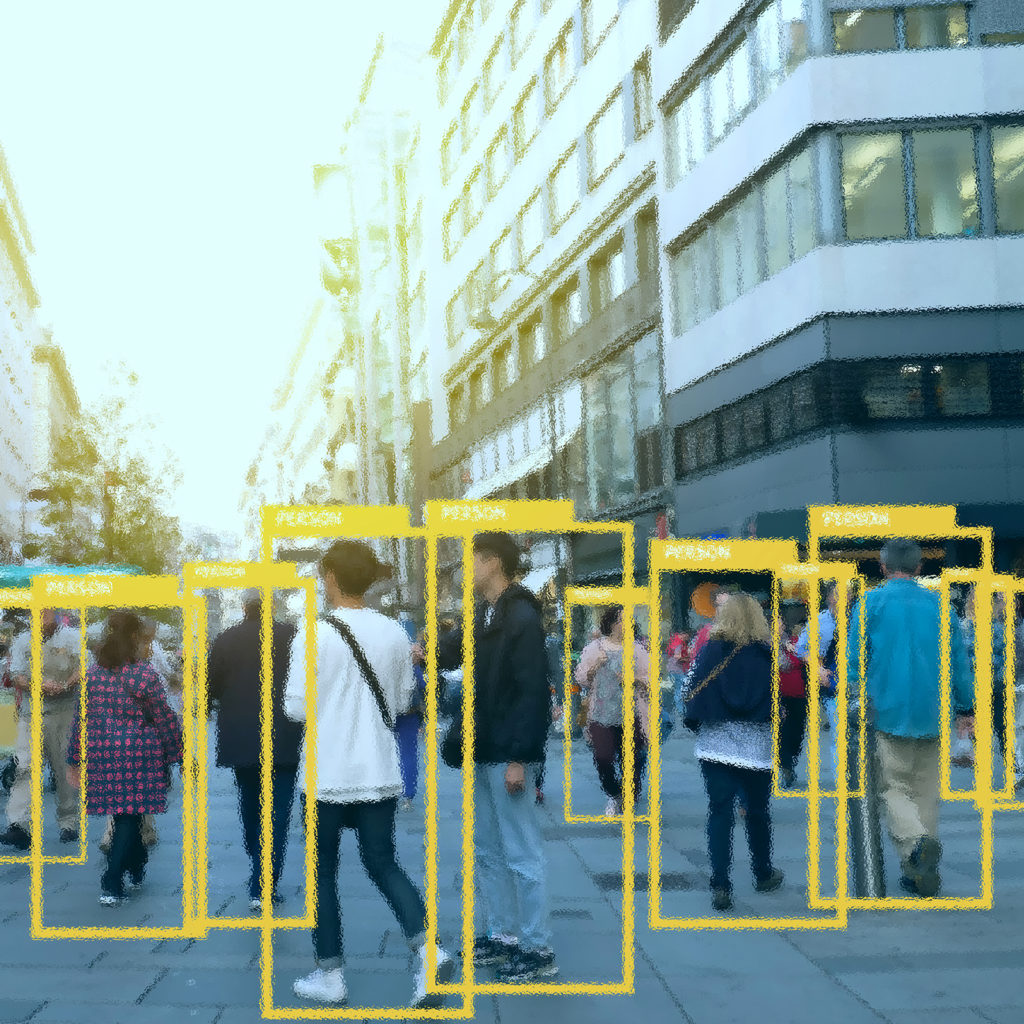

Le concept de Garantie Humaine peut paraître abstrait mais il est, en réalité, très opérationnel. Dans le cas de l’IA, l’idée est d’appliquer les principes de régulation de l’intelligence artificielle en amont et en aval de l’algorithme lui-même en établissant des points de supervision humaine. Non pas à chaque étape, sinon l’innovation serait bloquée. Mais sur des points critiques identifiés dans un dialogue partagé entre les professionnels, les citoyens et les concepteurs d’innovation.

Ce principe général ne veut pas dire, cependant, que le contrôle technique de l’algorithme lui-même ne sera pas assuré. En effet, si l’IA est intégrée à un dispositif technique numérique type objet connecté, elle sera soumise aux contrôles précis prévus dans le cadre des mécanismes de mise sur le marché des produits de santé.

La supervision peut s’exercer avec le déploiement de « collèges de Garantie Humaine » associant professionnels utilisateurs, citoyens et innovateurs. Leur vocation serait d’assurer a posteriori une révision de dossiers pour porter un regard humain sur les options conseillées ou prises par l’algorithme. L’objectif consiste à s’assurer « au fil de l’eau » que l’algorithme reste sur un développement de Machine Learning à la fois efficace et responsable éthiquement. Les dossiers à auditer pourraient être définis à partir d’événements indésirables constatés, de critères prédéterminés ou d’une sélection aléatoire.

Ce principe de Garantie Humaine avait été très clairement repris dans l’exposé des motifs et l’étude d’impact du projet de loi bioéthique. Il était ensuite intégré à l’article 11 du texte adopté à l’unanimité en première lecture à l’Assemblée nationale.

Il est désormais également repris dans le Livre Blanc de la Commission européenne sur l’IA publié le 11 février dernier et dans la réponse apportée par le Comité national pilote d’éthique du numérique et dans les orientations générales de l’Organisation Mondiale de la Santé en vue de l’émission d’une recommandation générale sur la régulation du numérique et de l’IA en santé.

Ces reconnaissances successives et de plus en plus larges du principe de Garantie Humaine de l’intelligence artificielle représentent autant d’avancées considérables de la logique de régulation positive du numérique et de l’IA portée par le CRAPS. Il convient à présent de poursuivre et d’approfondir les travaux pour décliner concrètement les corollaires et modalités de mise en œuvre de ce principe dans les différents domaines de la protection sociale.